Les 13 meilleurs outils d'automatisation open source pour 2026

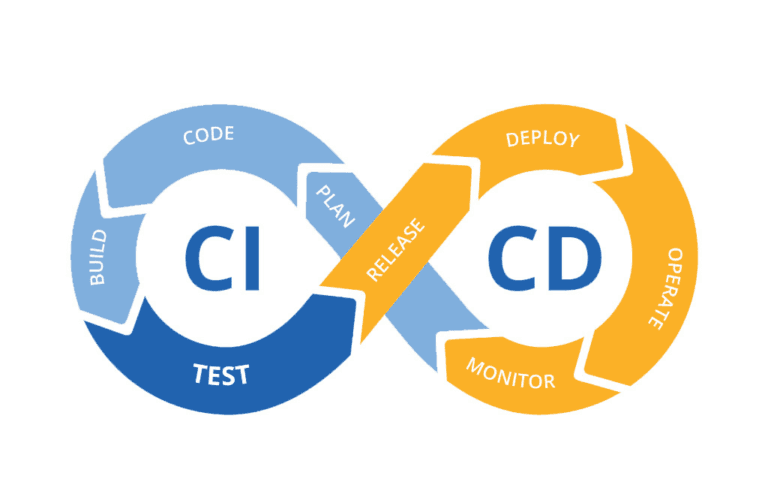

Les outils d'automatisation open source sont devenus un élément central des pratiques DevOps et d'infrastructure modernes, car ils offrent aux équipes la liberté de standardiser les processus, de supprimer les tâches répétitives et d'avancer plus vite sans sacrifier la fiabilité. Dans cet article, nous explorerons pourquoi ces outils sont importants, comment ils renforcent la collaboration DevOps et ce qui rend les communautés open source si précieuses pour la construction de plateformes résilientes et sécurisées.

Quels sont les outils d'automatisation open source ?

Les outils d'automatisation open source sont des plateformes logicielles qui permettent aux équipes d'automatiser les tâches de développement, d'exploitation et d'infrastructure sans être soumises à des licences propriétaires. Étant open source, leur code source est accessible à tous, ce qui permet à chacun d'en examiner le fonctionnement, d'étendre leurs fonctionnalités et de les adapter à des flux de travail spécifiques.

Pourquoi utiliser des outils d'automatisation open source ?

L'utilisation d'outils d'automatisation open source offre plusieurs avantages significatifs aux équipes DevOps et d'infrastructure, car elle combine flexibilité, transparence et valeur à long terme d'une manière que les plateformes propriétaires ne peuvent souvent pas égaler. Voici les principales raisons de leur large adoption :

Elles réduisent les coûts opérationnels : l’automatisation supprime les tâches manuelles répétitives et les remplace par des processus qui s’exécutent de manière constante. Il en résulte moins d’erreurs humaines, des cycles de livraison plus rapides et des environnements plus fiables.

Favoriser la transparence et la confiance : grâce à la disponibilité publique du code source, les équipes peuvent examiner le fonctionnement de l’outil et vérifier son niveau de sécurité. Cette visibilité accrue permet aux organisations d’avoir confiance dans l’interaction de leurs systèmes d’automatisation avec leurs infrastructures critiques.

Éviter la dépendance vis-à-vis d'un fournisseur unique : les projets open source vous permettent d'adapter vos flux de travail sans être limité par des écosystèmes fermés ou des modèles de tarification propriétaires. Cette liberté facilite la mise à l'échelle, l'intégration de nouveaux systèmes ou la migration vers différentes plateformes en fonction de l'évolution de vos besoins.

Prise en charge de la personnalisation et de l'extensibilité – Grâce à un code ouvert, les équipes peuvent modifier les outils pour gérer des flux de travail uniques, ajouter des fonctionnalités manquantes ou créer des plugins qui correspondent précisément à leur stratégie d'infrastructure.

Leur développement repose sur une forte collaboration communautaire : la plupart des outils d’automatisation open source bénéficient du soutien de communautés actives qui contribuent à la correction des bogues, aux mises à jour de sécurité et à l’ajout de nouvelles fonctionnalités. Ce rythme d’amélioration collaboratif permet aux outils de rester modernes et fiables.

Rentable pour les organisations de toutes tailles – Sans frais de licence pour leurs éditions open source et avec une large compatibilité entre les environnements, l'automatisation open source offre une voie abordable vers des pratiques DevOps matures , même pour les petites équipes ou les équipes en croissance rapide.

Meilleurs outils d'automatisation open source

Vous trouverez ci-dessous une sélection des principaux outils d'automatisation open source utilisés dans les domaines du DevOps et de l'ingénierie d'infrastructure. Chacun d'eux bénéficie d'un solide soutien communautaire, d'une fiabilité éprouvée et d'une parfaite adéquation avec les flux de travail natifs du cloud.

Les meilleurs outils d'automatisation open source comprennent :

1. Intention de transport spatial

Spacelift Intent est un outil d'automatisation open source et agentique (piloté par l'IA) qui provisionne et gère les ressources cloud à partir de requêtes en langage naturel. Fonctionnant comme un serveur MCP, il s'intègre aux assistants IA et aux éditeurs, interprète les requêtes et appelle directement les API des fournisseurs de cloud, permettant ainsi aux équipes de prototyper rapidement leur infrastructure sans avoir à écrire de code HCL ni de Terraform.

L'édition open source, auto-hébergée et légère, avec stockage local des données, est idéale pour l'expérimentation et les petites installations. Elle est encore en développement et expérimentale. Une version d'accès anticipé gérée s'intègre à la plateforme Spacelift pour répondre aux besoins en matière de politiques, de garde-fous et d'audit.

Caractéristiques principales de Spacelift Intent

Provisionnement en langage naturel : décrivez la ressource dont vous avez besoin et créez-la via des appels directs à l’API du fournisseur, ce qui évite les étapes de génération de modèles.

Compatible avec les fournisseurs Terraform/OpenTofu : Réutilise l’écosystème de fournisseurs publics ; ainsi, si un fournisseur fonctionne avec OpenTofu ou Terraform, il fonctionnera également avec Intent.

Suivi d'état intégré : Intent enregistre les ressources dans une base de données SQLite locale afin de garantir la cohérence et la traçabilité des opérations.

Intégration MCP entre les outils : connectez-vous depuis VS Code ou Claude Desktop à l’aide de Docker ou Homebrew pour un flux de travail de développement fluide.

Voie de gouvernance avec Spacelift : L’accès anticipé commercial ajoute des politiques centralisées, des approbations et des pistes d’audit pour un contrôle au niveau de la plateforme

Licence : Licence Apache 2.0

Site web :

Documentation officielle :

2. OpenTofu

OpenTofu est un outil d'infrastructure en tant que code (IaC) open source, piloté par la communauté et constituant une alternative directe à Terraform. Gouverné par la Linux Foundation, il reste compatible avec les fournisseurs et modules Terraform, permettant ainsi aux équipes de conserver leurs flux de travail habituels tout en restant entièrement open source.

Il dispose d'un registre en constante expansion et offre une solution fiable et flexible pour l'automatisation des ressources cloud et sur site.

Principales caractéristiques d'OpenTofu

Flux de travail compatibles avec Terraform : utilisez le même modèle déclaratif et les mêmes commandes grâce à des instructions de migration claires pour les bases de code existantes.

Écosystème riche de fournisseurs et de modules : accédez à des milliers d’intégrations via le registre OpenTofu pour les cas d’utilisation multicloud et tiers

Plans d'exécution et graphe des ressources : prévisualisez les modifications avant leur exécution et bénéficiez d'opérations parallèles respectant les dépendances.

Gestion d'état avec chiffrement : gérez l'état localement ou dans des serveurs distants et activez le chiffrement d'état intégré côté client pour protéger les données sensibles.

Améliorations continues pour la testabilité et la mise à l'échelle : les versions récentes ajoutent des fonctionnalités telles que l'évaluation précoce des variables et des variables locales, ainsi que la simulation de fournisseurs dans les tests Tofu , améliorant ainsi les flux de travail à grande échelle et la sécurité de l'intégration continue.

Licence : Licence publique Mozilla 2.0 (MPL-2.0)

Site web : https://opentofu.org

Documentation officielle : https://opentofu.org/docs/

Lire la suite : OpenTofu à grande échelle : 4 stratégies et bonnes pratiques de mise à l’échelle

3. Pulumi

Pulumi est une plateforme d'infrastructure en tant que code (IaC) open-source qui vous permet de définir, de provisionner et de gérer des ressources cloud à l'aide de langages généralistes tels que TypeScript, Python, Go, .NET, Java et YAML.

Il cible les environnements multicloud et Kubernetes, et son interface de ligne de commande et son moteur sont distribués sous licence Apache 2.0. Un service hébergé optionnel offre des fonctionnalités de collaboration, notamment la gestion d'état et l'application de politiques.

Caractéristiques principales de Pulumi

Infrastructure en tant que code (IaC) multilingue : Créez une infrastructure avec des langages de programmation courants, tels que Node.js, Python, Go, .NET, Java et YAML, permettant aux équipes de réutiliser des bibliothèques, des outils de test et des modèles qu’elles connaissent déjà.

API d'automatisation pour l'intégration : Pilotez le démarrage, la prévisualisation et la suppression de Pulumi directement depuis le code afin d'intégrer le provisionnement dans des portails de développeurs personnalisés, des systèmes d'intégration continue ou des plateformes internes.

Gestion flexible de l'état : stockez l'état dans Pulumi Cloud ou exécutez une gestion entièrement autonome à l'aide d'un stockage d'objets tel que S3, Azure Blob Storage, Google Cloud Storage, des systèmes de stockage compatibles S3 ou le système de fichiers local.

La politique en tant que code avec CrossGuard : appliquez des règles de sécurité, de coût et de conformité dès le déploiement grâce à des politiques programmables et déployez-les sur l’ensemble des piles pour créer des flux de travail contrôlés et auditables.

Écosystème de fournisseurs étendu : Gérez vos ressources sur AWS, Azure, Google Cloud, Kubernetes et plus d’une centaine de services supplémentaires grâce au registre Pulumi et aux plugins de fournisseurs.

Licence : Licence Apache 2.0

Site web : https://www.pulumi.com

Documentation officielle : https://www.pulumi.com/docs/

Lire la suite : Gestion de l’État de Pulumi – Comment ça marche et où le stocker

4. Ansible

Ansible est un moteur d'automatisation open source pour la gestion de la configuration, le déploiement d'applications et l'orchestration sur Linux, Windows, les périphériques réseau et les services cloud. Il utilise des playbooks YAML simples pour décrire l'état souhaité, se connecte via SSH ou WinRM sans agent et s'adapte aussi bien aux tâches ponctuelles qu'aux flux de travail répétables grâce au contenu réutilisable de ses collections communautaires.

Fonctionnalités clés d'Ansible

Connexions sans agent : gérez les cibles Linux et Unix via SSH et les hôtes Windows via WinRM, en évitant les contraintes liées à l’installation et à la maintenance d’agents.

Playbooks YAML : définissez les tâches et les rôles dans un langage YAML lisible par l’humain, permettant une automatisation claire et versionnable que les équipes peuvent examiner et réutiliser.

Modules idempotents : La plupart des modules ne changent de système qu’en cas de besoin, ce qui contribue à prévenir la dérive et à rendre les exécutions répétées prévisibles.

Inventaire flexible : Suivez et regroupez l’infrastructure dans des fichiers statiques ou importez-la dynamiquement depuis le cloud et d’autres systèmes pour les flottes importantes et évolutives.

Collections extensibles : ajoutez des fournisseurs, des modules, des rôles et des plugins via Ansible Collections et l’écosystème Galaxy pour couvrir diverses plateformes.

Licence : Licence publique générale GNU v3.0 (GPL-3.0)

Site web : https://www.ansible.com

Documentation officielle : https://docs.ansible.com/ansible/latest/

Lire la suite : Utiliser Ansible dans les flux de travail CI/CD : Guide et exemples

5. Jenkins

Jenkins est un serveur d'automatisation open source utilisé depuis longtemps pour compiler, tester et déployer des logiciels via des pipelines d'intégration et de livraison continues. Les équipes définissent ces pipelines sous forme de code dans un fichier Jenkinsfile stocké avec le projet, puis les exécutent sur un ou plusieurs agents de compilation afin de paralléliser le travail et d'accélérer le retour d'information.

Principales caractéristiques de Jenkins

Pipeline as Code : définissez et versionnez votre processus CI/CD dans un Jenkinsfile stocké avec votre code applicatif pour une automatisation reproductible et vérifiable.

Écosystème de plugins extensible : enrichissez vos fonctionnalités grâce à des milliers de plugins communautaires qui intègrent des outils tout au long de la chaîne de développement, de test, de sécurité et de déploiement.

Déploiements distribués avec agents : faites évoluer les charges de travail en ajoutant des nœuds et des agents, en isolant les environnements et en exécutant des tâches en parallèle, tandis que le contrôleur coordonne l’exécution.

Choix de la fréquence de publication : Optez pour la version LTS pour une stabilité optimale ou la version hebdomadaire pour des mises à jour plus rapides, selon votre tolérance au risque et vos besoins.

Découverte SCM et gestion multibranches : Détection automatique des dépôts et des branches pour la création et la gestion des tâches sans configuration manuelle

Licence : Licence MIT

Site web : https://www.jenkins.io

Documentation officielle : https://www.jenkins.io/doc/

Lire la suite : Terraform avec Jenkins – Comment gérer les flux de travail

6. Marionnette

Puppet est un outil de gestion de configuration open source qui permet aux équipes de définir l'état système souhaité sous forme de code et de l'appliquer à l'ensemble des systèmes. Il utilise un langage déclaratif pour décrire les ressources, compile ces définitions en catalogues et applique les modifications afin que les systèmes convergent vers l'état prévu.

Puppet fonctionne selon un modèle agent-serveur via HTTPS avec des certificats, et il peut extraire des données riches à partir de faits et de sources de données externes pour maintenir des configurations cohérentes et auditables.

Caractéristiques principales de Puppet

Modèle de configuration déclaratif : Décrivez l’état souhaité en langage Puppet et laissez la plateforme calculer les étapes pour l’atteindre, garantissant ainsi des résultats prévisibles d’une exécution à l’autre.

Architecture agent et serveur : Utilisation d’un serveur principal et d’agents gérés communiquant via HTTPS avec une autorité de certification intégrée pour des opérations sécurisées et évolutives

Application idempotente : Appliquer les catalogues de manière répétée pour corriger les dérives et maintenir les systèmes conformes à la politique sans modifications inutiles.

Séparation des données avec Hiera et les faits : stockez les données de configuration en dehors du code et interrogez les faits système pour piloter la logique conditionnelle et les modèles réutilisables.

Vaste écosystème de modules : Réutilisez le contenu communautaire et pris en charge de Puppet Forge pour ajouter des fournisseurs, des types, des rôles et des tâches pour de nombreuses plateformes.

Licence : Licence Apache 2.0

Site web : https://www.puppet.com

Documentation officielle : https://help.puppet.com/

💡 Vous pourriez aussi aimer :

11 façons d'améliorer l'orchestration de votre infrastructure

Pourquoi vous avez besoin d'une infrastructure en libre-service

Création d'une infrastructure évolutive : stratégies et bonnes pratiques

7. Chef

Chef est une plateforme de gestion de configuration open source qui transforme l'infrastructure en code et maintient les systèmes dans l'état souhaité, quel que soit le cloud ou le datacenter. Les équipes créent des cookbooks dans un DSL basé sur Ruby, les testent et les empaquetent sur Workstation, puis exécutent Chef Infra Client sur des nœuds qui communiquent avec Chef Infra Server via des API authentifiées et SSL pour une convergence fiable.

L'écosystème est mature et axé sur la communauté, avec des milliers de livres de recettes réutilisables disponibles via Chef Supermarket pour accélérer les tâches et les schémas courants.

Caractéristiques principales du chef

Ressources déclaratives et cookbooks : Décrivez l’état cible à l’aide des ressources Chef Infra et d’un DSL Ruby afin que la plateforme calcule comment atteindre et maintenir cet état de manière prévisible.

Modèle agent et serveur : utilisez Chef Infra Client sur chaque nœud, tandis que Chef Infra Server gère les requêtes authentifiées et les certificats pour garantir la sécurité des opérations de votre parc d’infrastructures.

Convergence idempotente : les exécutions répétées ne modifient que ce qui est nécessaire, grâce à des mécanismes de protection et des bonnes pratiques qui contribuent à prévenir la dérive et à garantir la cohérence des résultats.

Chaîne d'outils Workstation : Créez et testez vos automatisations localement avec Chef Workstation, qui regroupe les outils de création, de gestion des dépendances et de test pour un flux de travail de développement fluide.

Écosystème communautaire riche : exploitez le contenu éprouvé de Chef Supermarket pour accélérer l’adoption et standardiser les implémentations sur toutes les plateformes.

Licence : Licence Apache 2.0

Site web : https://www.chef.io

Documentation officielle : https://docs.chef.io/

8. Sel

Salt est un framework d'automatisation open source pour la gestion de la configuration, l'exécution à distance et l'orchestration événementielle dans les environnements Linux, Windows et cloud. Il permet de définir l'état du système sous forme de code et d'exécuter rapidement des commandes sur de vastes parcs de systèmes, ce qui le rend utile aussi bien pour les opérations quotidiennes que pour les déploiements complexes.

Ce projet fait partie de l'écosystème open-source Salt et est actuellement soutenu et géré par Broadcom.

Caractéristiques principales du sel

Gestion de la configuration et exécution à distance : imposez l’état souhaité grâce à des états déclaratifs et exécutez des commandes ad hoc sur les nœuds cibles pour des diagnostics et des modifications rapides.

Option sans agent avec Salt SSH : Gérez vos systèmes via SSH sans installer d’agent persistant lorsque ce modèle correspond à vos besoins en matière de sécurité ou de contrôle des changements.

Automatisation événementielle : utilisez des balises et le réacteur pour surveiller les événements système et déclencher automatiquement des actions, créant ainsi des flux de travail réactifs et autoréparateurs.

Architecture évolutive : exploitez un nœud maître et de nombreux nœuds secondaires grâce à des fonctionnalités telles que Syndic et le clustering pour gérer des environnements distribués de grande envergure.

Vaste écosystème de modules et d'intégrations : étendez les fonctionnalités grâce à des modules d'exécution, d'état et de cloud couvrant un large éventail de plateformes et de fournisseurs.

Licence : Licence Apache 2.0

Site web : https://saltproject.io

Documentation officielle : https://docs.saltproject.io/en/latest/

9. Moteur CFE

CFEngine est une plateforme de gestion de configuration open source conçue pour une mise à l'échelle élevée et une faible surcharge. Elle définit l'état souhaité sous forme de politique, exécute un agent léger sur chaque nœud et assure la convergence continue des systèmes vers cet état grâce à une application locale rapide.

Les politiques sont rédigées sous forme de promesses, vérifiées avant leur exécution et appliquées régulièrement afin de garantir la conformité et la sécurité des grandes flottes dans des environnements divers.

Principales caractéristiques de CFEngine

Agent léger à grande échelle : fonctionne avec une consommation de ressources minimale tout en gérant des dizaines, voire des centaines de milliers de nœuds répartis dans des centres de données, le cloud et des systèmes embarqués.

Politique sous forme de promesses : Exprimez l’état souhaité sous forme de promesses que CFEngine vérifie et applique, permettant ainsi des changements prévisibles et auditables.

Convergence autonome et continue : les agents effectuent un contrôle par défaut toutes les cinq minutes et corrigent automatiquement les écarts pour maintenir la conformité.

Modèle client-serveur sécurisé : utilisation de clés et de connexions authentifiées entre les agents et le hub pour une distribution sécurisée des politiques et des rapports.

Écosystème mature et documentation : Accédez à une documentation de référence complète, à des tutoriels et à des modules pour accélérer l'adoption et standardiser les flux de travail.

Licence : Licence publique générale GNU v3.0 (édition communautaire) ; édition commerciale Entreprise disponible

Site web : https://cfengine.com

Documentation officielle : https://docs.cfengine.com/

10. Gouvernail

Rudder est une plateforme open source de gestion de configuration, de correctifs et de conformité continue. Elle combine une console web centralisée, un agent léger et un modèle de politiques pour auditer les configurations, imposer l'état souhaité et rendre compte de l'état en temps réel sur les systèmes Linux et Windows.

Conçu pour une utilisation à grande échelle, il aide les équipes d'exploitation et de sécurité à maintenir des flottes cohérentes, visibles et alignées sur les normes, tout en préservant la simplicité des flux de travail quotidiens.

Caractéristiques principales du gouvernail

Modes d'audit continu ou de correction automatique : choisissez de vérifier uniquement les paramètres ou de corriger automatiquement les dérives, au niveau global, système ou de configuration.

Interface web centralisée : définissez des politiques, groupez des nœuds, consultez des rapports et suivez la conformité depuis un plan de contrôle visuel.

Architecture d'agents évolutive : Utilisez un agent local léger pour une convergence rapide des systèmes et une gestion fiable des flottes importantes.

Accès API étendu : intégrez des scripts et des outils externes via une API REST pour une automatisation au-delà de l’interface utilisateur.

Informations de conformité : Surveillez la conformité aux politiques et aux normes grâce à un statut en temps réel et des analyses approfondies permettant d'agir en profondeur.

Licence : Licence publique générale GNU v3.0 (GPL-3.0) pour les composants principaux

Site web : https://www.rudder.io

Documentation officielle : https://docs.rudder.io/

11. CD Argo

Argo CD est un outil de livraison continue GitOps déclaratif et open source pour Kubernetes. Il utilise Git comme source de référence, compare l'état souhaité aux clusters en production et synchronise les modifications de manière contrôlée via un contrôleur Kubernetes et une interface utilisateur en temps réel.

Argo est un projet diplômé de la CNCF, ce qui témoigne d'une gouvernance active et d'une large adoption en production.

Caractéristiques clés du CD Argo

Déploiement GitOps déclaratif : synchronisez en continu l’état du cluster avec les données définies dans Git et affichez les écarts et les différences avant la synchronisation.

Formats de manifestes multiples : utilisez Kustomize, Helm, Jsonnet, YAML simple ou des plugins de configuration personnalisés sans modifier votre flux de travail.

Gestion multi-clusters et multi-applications : ciblez plusieurs clusters et générez des applications à grande échelle avec ApplicationSet.

Contrôles de santé, de restauration et de synchronisation : Consultez l’état des ressources, restaurez une configuration validée dans Git et choisissez une synchronisation automatique ou manuelle.

Sécurité d'accès et politiques : intégrez l'authentification unique (SSO), utilisez le contrôle d'accès basé sur les rôles (RBAC) pour la mutualisation et conservez un historique des événements et des appels d'API.

Licence : Licence Apache 2.0

Site web : https://argo-cd.readthedocs.io/

Documentation officielle : https://argo-cd.readthedocs.io/en/stable/

Lire la suite : Utilisation d’ArgoCD et de Terraform pour gérer un cluster Kubernetes

12. Prométhée

Prometheus est une suite logicielle open source de surveillance et d'alerte des systèmes, conçue pour la fiabilité et l'évolutivité. Elle collecte des métriques de séries temporelles en interrogeant les points de terminaison HTTP, les stocke dans une base de données de séries temporelles (TSDB) dédiée, permet de les interroger avec PromQL et achemine les alertes via Alertmanager. Ce projet est membre diplômé de la CNCF et est largement utilisé pour automatiser l'observabilité dans les environnements cloud et sur site.

Caractéristiques principales de Prometheus

Collecte de métriques par extraction : collecte à intervalles réguliers les cibles configurées via HTTP, permettant ainsi aux opérateurs de contrôler les éléments surveillés et leur fréquence.

PromQL pour des requêtes puissantes : un langage de requête flexible pour explorer, agréger et transformer des séries temporelles pour les tableaux de bord et le dépannage.

Découverte de services et exportateurs : découvre les cibles de manière dynamique et exploite un vaste écosystème d’exportateurs pour exposer les métriques des systèmes existants.

Alerte avec Alertmanager : Envoie les alertes issues des évaluations de règles à Alertmanager, qui gère la déduplication, le regroupement, la mise en sourdine et le routage vers des outils tels que la messagerie électronique ou PagerDuty.

Règles d'enregistrement et fédération : Précalculez les expressions complexes grâce aux règles d'enregistrement et faites évoluer les architectures en fédérant les données entre les serveurs Prometheus.

Licence : Licence Apache 2.0

Site web : https://prometheus.io

Documentation officielle : https://prometheus.io/docs/introduction/overview/

Lire la suite : Configuration de Prometheus avec Helm Chart sur Kubernetes

13. Apache Airflow

Apache Airflow est une plateforme open source permettant de concevoir, planifier et superviser des workflows sous forme de code. Les équipes définissent des graphes acycliques orientés en Python, les exécutent sur un planificateur et des nœuds de calcul évolutifs, et suivent chaque exécution via une interface web qui rend les pipelines visibles et débogables.

Elle est largement adoptée pour l'automatisation des données et des plateformes dans les environnements cloud et sur site.

Caractéristiques principales d'Apache Airflow

Flux de travail sous forme de code Python : créez des DAG qui expriment les dépendances entre les tâches, les planifications et les rappels, pour une automatisation versionnable et testable.

Planificateur et exécuteurs robustes : orchestrez les tâches sur des exécuteurs locaux, Celery ou Kubernetes pour une mise à l’échelle allant d’un ordinateur portable à de grands clusters.

Interface Web pour une meilleure visibilité : inspectez les exécutions, consultez les journaux, relancez les tâches et gérez les déploiements via une interface moderne.

Opérateurs et intégrations modulaires : Utilisez des opérateurs prêts à l’emploi pour AWS, GCP, Azure et de nombreux services tiers afin de connecter vos flux de travail.

Extensible et piloté par API : étendez-le avec des opérateurs, des capteurs et des hooks personnalisés, et utilisez l’API REST et l’interface de ligne de commande Airflow pour une automatisation sécurisée et auditable.

Licence : Licence Apache 2.0

Site web : https://airflow.apache.org

Documentation officielle : https://airflow.apache.org/docs/

Quel outil d'automatisation open source choisir ?

Pour vous aider à mieux comprendre le rôle de chacun des outils décrits ci-dessus, voici un tableau comparatif rapide :

Outil Catégorie Utilisation principale Modèle d'exécution Configuration / langue Gestion de l'état Points forts notables

Intention de transport spatial Automatisation de l'infrastructure agentique Provisionner des ressources cloud à partir de requêtes en langage naturel Le serveur interprète les requêtes et appelle directement les fournisseurs. Invites en langage naturel associées aux API du fournisseur suivi local dans un stockage léger Prototypage rapide, réutilisation des fournisseurs Terraform et OpenTofu, prise en main facile pour les petites expérimentations

OpenTofu Infrastructure en tant que code Définir et provisionner des ressources cloud et sur site Planification déclarative et application via l'interface de ligne de commande HCL avec modules et fournisseurs Systèmes de gestion d'état locaux ou distants avec verrouillage Des flux de travail compatibles avec Terraform et un modèle communautaire entièrement ouvert

Pulumi Infrastructure en tant que code Provisionner et gérer des environnements multicloud et Kubernetes État souhaité déclaratif exprimé avec du code à usage général TypeScript, Python, Go, .NET, Java, YAML Stockage local, stockage d'objets ou cloud Pulumi Ergonomie de développement robuste et fonctionnalités linguistiques riches avec un large éventail de fournisseurs

Ansible Gestion et automatisation de la configuration Configurer les systèmes, déployer les applications, orchestrer les tâches Envoi depuis le nœud de contrôle via SSH ou API Les playbooks et les rôles YAML Aucun fichier d'état persistant sur les cibles Déploiement sans agent et un vaste écosystème de modules et de collections

Jenkins Automatisation CI Concevoir, tester et livrer des logiciels Serveur avec des agents qui exécutent des pipelines Pipelines déclaratifs ou scriptés dans Jenkinsfile Conserve l'historique des emplois et les artefacts Modèle de plugins très extensible et large adoption par l'écosystème

Fantoche Gestion de la configuration Imposer l'état souhaité aux flottes Effectuer une opération de récupération avec des agents se connectant à un serveur Puppet DSL, données Hiera Catalogues et rapports gérés par le serveur Approche mature axée sur les modèles avec des vues solides en matière de reporting et de conformité

Cuisinier Gestion de la configuration Converger les systèmes vers la politique Tirer avec des agents exécutant des recettes Ruby DSL pour les recettes et les livres de cuisine Les flux de travail Server ou Solo suivent les exécutions Primitives puissantes pour la logique nodale complexe et les modèles pilotés par les tests

Sel Configuration et orchestration Configurer les flottes et exécuter à distance Maître avec agents « sbires », également modes sans agent YAML SLS avec Jinja Structure en grains et piliers pour les données, bus d'événements pour l'orchestration Modèle rapide et événementiel adapté aux opérations en temps réel de grande envergure

Moteur CFE Gestion de la configuration Application des politiques légère et à grande échelle Agents autonomes avec des exécutions planifiées Langage de politique de CFEngine Base de connaissances locales avec rapports centralisés Encombrement réduit et performances exceptionnelles sur de vastes domaines

Gouvernail Gestion de la configuration et conformité Configuration continue avec audit Système à agents avec serveur central DSL basé sur des techniques, interface utilisateur web, API Inventaire central et rapports de conformité Bibliothèque de politiques, tableaux de bord de conformité et validation des modifications

CD Argo Livraison continue GitOps Synchroniser les clusters Kubernetes avec l'état Git Contrôleurs basés sur le principe du pull dans le cluster Manifestes Kubernetes, Helm, Kustomize État souhaité vs état réel suivi dans le cluster Flux de travail GitOps natifs avec détection claire des dérives et restauration

Prométhée Surveillance et alerte Métriques et alertes de séries temporelles Récupérer les données des cibles, les envoyer via les passerelles si nécessaire Configurations YAML, PromQL pour les requêtes TSDB local par serveur avec écriture à distance optionnelle Un langage de requête puissant et un vaste écosystème d'exportation

Apache Airflow Orchestration des flux de travail Créer, planifier et observer les pipelines Le planificateur répartit les tâches entre les exécutants. DAGs Python avec opérateurs Base de données de métadonnées pour les courses et la lignée Vue DAG claire, intégrations robustes et code de flux de travail reproductible

Points clés

L'automatisation open source joue un rôle central dans des flux de travail DevOps stables et évolutifs. Elle permet de reproduire les processus, d'accélérer les déploiements et de réduire les coûts opérationnels. La transparence favorise l'innovation et aide les équipes à adopter les meilleures pratiques sans dépendance excessive.

Dans ce guide, nous avons passé en revue 13 outils d'automatisation open source populaires. À mesure que votre infrastructure évolue, l'adoption d'une automatisation flexible vous permettra de garder le contrôle face à la complexité croissante des environnements et favorisera une culture d'ingénierie plus performante et plus confiante.

Résolvez vos problèmes d'infrastructure

Spacelift est une solution d'orchestration flexible pour le développement IaC. Elle offre une collaboration, une automatisation et des contrôles améliorés afin de simplifier et d'accélérer le provisionnement des infrastructures cloud.